Como abrir espaço para a IA na sua organização

No passado, grandes ondas tecnológicas trouxeram inovações que conviveram bem com a estrutura existente nas empresas. Mas esse não é o caso da IA generativa. As organizações podem acomodá-la melhor no dia a dia se fizerem adaptações, aqui sugeridas em três passos

- Plataformas de saúde precisam rever suas estratégias

- Há algo de errado com os concursos de inovação

- O Brasil deveria liderar a inteligência artificial (aberta)

- Oito perguntas e respostas sobre o custo/benefício da IA generativa

- Você está avaliando o machine learning do modo errado

- Como abrir espaço para a IA na sua organização

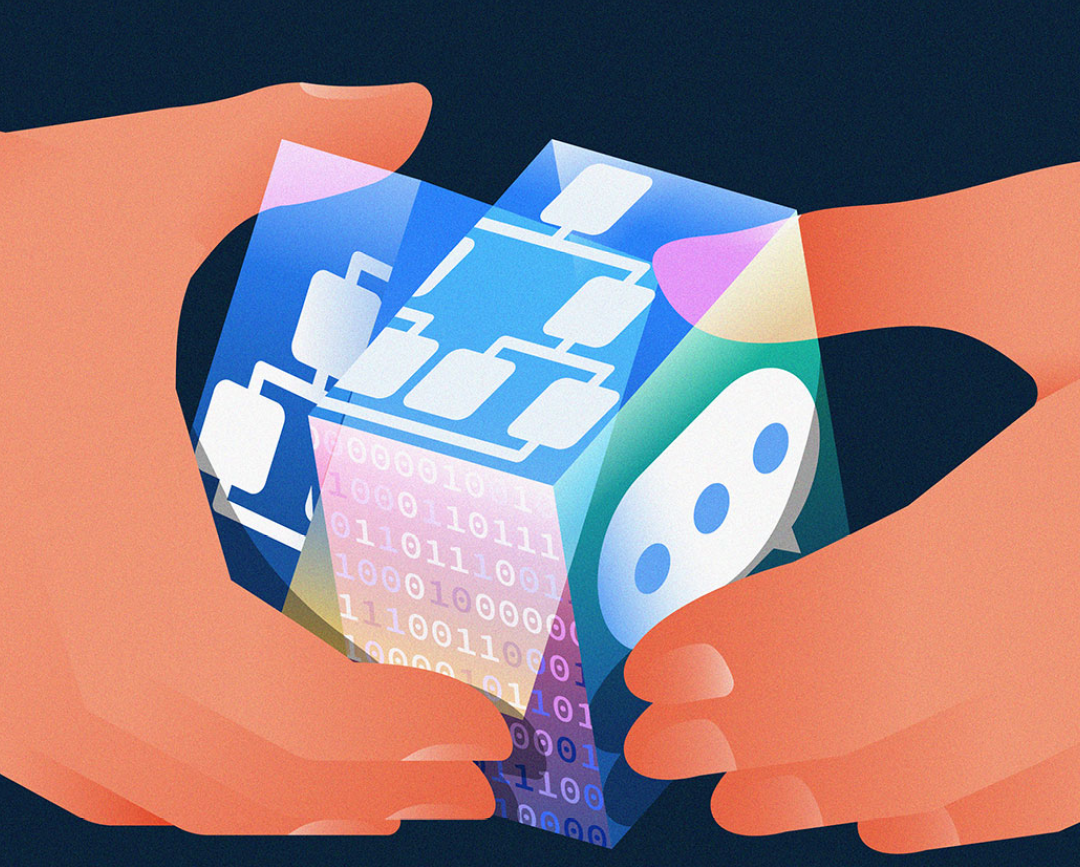

A era dos organogramas chegou ao fim. Ela remonta a 1855, quando o primeiro organograma abriu alas para a estrutura organizacional que conhecemos, atravessou séculos, assimilou novas tecnologias e terminou nos anos 2020, quando sucumbiu ao Large Language Model (LLM, na sigla em inglês). É o surgimento de uma nova era na estrutura do trabalho.

Trata-se, evidentemente, de uma afirmação ousada. No passado, houve outras novidades tecnológicas que também desafiaram as estruturas das organizações (se você tem a holocracia em mente, acertou).

Porém a verdade é que, passageira ou não, cada onda trouxe inovações que fortaleceram as organizações tradicionais. Henry Ford aproveitou os avanços em relógios mecânicos e peças padronizadas para introduzir linhas de montagem e formas mais precisas de dividir o trabalho, por exemplo.

Já a inteligência artificial generativa – e os modelos de linguagem conhecidos como LLMs que a alimentam – são outra história. Os métodos anteriores de organização eram intensamente humanos, construídos sobre as capacidades e limitações humanas. Daí os modelos organizacionais tradicionais terem se mantido por tanto tempo.

Como a capacidade humana de atenção e execução é finita, precisávamos delegar nossas tarefas aos outros. Como número de pessoas que podem trabalhar em uma equipe é limitado, tínhamos que dividir as organizações em partes menores. Como a tomada de decisão é complicada, abraçamos as camadas de gestão e autoridade.

Em suma, a tecnologia muda, mas trabalhadores e gerentes são apenas pessoas, e a única maneira que tínhamos, até então, de somar inteligência a um projeto era adicionando pessoas ou fazendo-as trabalhar de maneira mais eficiente por meio de ferramentas que as ajudassem a se comunicar ou acelerar seu trabalho.

Mas isso já não é mais verdade. Qualquer pessoa pode adicionar algum tipo de inteligência a um projeto com uma solução de inteligência artificial (IA). E as evidências mostram que isso já vem ocorrendo – mesmo que os funcionários nem sempre contem a seus chefes. Uma pesquisa de 2023 revelou que mais da metade das pessoas que usam IA no trabalho estão fazendo isso sem autorização.

Em boa medida, esse uso disfarçado é possível porque as ferramentas baseadas em LLMs são especialmente adequadas para lidar com papéis organizacionais – podem ler documentos, escrever e-mails, adaptar-se ao contexto e ajudar em projetos, sem exigir que os usuários tenham treinamento especializado ou software complexo e personalizado. Pessoas com acesso ao ChatGPT podem simplesmente começar a fazer com que a IA trabalhe para elas. E claramente estão fazendo exatamente isso.

O IMPACTO DA IA NO DESIGN ORGANIZACIONAL E EM SEUS PROCESSOS

Como reconstruir uma organização em torno de uma mudança fundamental na forma como o trabalho é realizado, organizado e comunicado?

O desafio que IA impõe ao processo organizacional é repensar estruturas tradicionais de trabalho, hierarquias e métodos de comunicação para se adaptar à sua crescente influência na realização das tarefas.

E não para por aí. Como integrar efetivamente a IA nas operações, redefinir papéis e responsabilidades e proporcionar treinamento e desenvolvimento para que os funcionários se adequem a esse novo ambiente de trabalho, impulsionado pela tecnologia?

Já experimentei um pouco disso na Wharton Interactive, uma startup de software incubada na Wharton School, na University of Pennsylvania (EUA), dedicada a trazer transformações para a educação por meio de simulações baseadas em IA.

Dada a nossa missão, incorporamos o poder dos LLMs e adotamos ferramentas de IA para executar diversas funções, como se estivéssemos adicionando várias pessoas à equipe. A remuneração total desses “membros virtuais” é inferior a US$ 100 por mês, em assinaturas do ChatGPT Plus e custos de interface de programação de aplicativos.

Contudo, isso é apenas o começo. Estamos estudando como mudar completamente os processos organizacionais. Aprendemos que podemos fazer com que a IA atue como um testador de software para feedback inicial em nossos projetos. Ela pode gravar e combinar nossas ideias com pouca supervisão humana, o que nos permite pular algumas reuniões. Também orienta nossos encontros de trabalho, de forma que nos concentremos não só no planejamento, mas na construção da solução. Ela cria páginas web e imagens com base em nossas ideias e entrega o protótipo do nosso projeto web, mesmo sem termos experiência em programação.

Já podemos imaginar um mundo em que agentes autônomos de IA começam com um conceito e vão até o código e a implantação com o mínimo de intervenção humana. Esse é, de fato, um objetivo declarado da próxima fase de desenvolvimento dos produtos da OpenAI. É provável que, se as taxas de alucinação da GenAI diminuírem em futuras versões, tarefas inteiras possam ser terceirizadas para esses agentes, com humanos apenas supervisionando.

Isso representa uma mudança e tanto na forma como o trabalho é feito e organizado, com implicações profundas para a economia, o emprego e a sociedade como um todo.

DECIDA ENTRE ORIENTAR E MANIPULAR

O futuro das organizações que se valerem da IA pode ir em muitas direções. Ao gerenciar o trabalho ou ajudar os gestores a fazê-lo, os refinados recursos dos LLMs tendem a trazer muitas mudanças, que podem ser positivas ou negativas. Uma única IA é capaz de falar com centenas de trabalhadores, monitorar seus desempenhos e dar conselhos.

Mas, se por um lado, elas podem orientar, de outro, podem manipular. Fato é que têm poder de influenciar decisões de maneira ostensiva ou mais sutil.

Empresas vêm experimentando formas de controle informatizado sobre os trabalhadores desde muito antes desta geração de IA. Relógios de ponto, câmeras e outros instrumentos de monitoramento e controle são comuns há mais de um século. No entanto, eles ganharam novos contornos e velocidade com o surgimento de ferramentas de IA pré-LLM, particularmente com a adoção de algoritmos para essa finalidade.

Pense no motorista de aplicativo esperando que a Uber lhe direcione clientes, apesar de sua nota geral não ser boa. Imagine o entregador da UPS, cujo minuto de deslocamento é examinado por um algoritmo para ver se ele é eficiente o bastante para manter seu trabalho no aplicativo.

Katherine Kellogg, professora de administração e inovação na MIT Sloan School of Management, juntamente com Melissa Valentine e Angèle Christin, ambas professoras da Stanford University, observaram como esses novos tipos de controle diferem dos anteriores. Se antes os gestores tinham acesso limitado sobre o que os trabalhadores faziam, agora os algoritmos fornecem um panorama abrangente e quase instantâneo, baseado em enormes volumes de dados e de diversas fontes.

Eles também funcionam de maneira interativa, atribuindo aos trabalhadores – em tempo real – as tarefas definidas pela empresa de plataforma. O problema é que esses algoritmos, em geral, não são transparentes. Seus vieses e padrões de tomada de decisão não ficam claros.

Poderíamos imaginar como os LLMs seriam capazes de turbinar esse processo, criando uma imagem ainda mais detalhada, abrangente e preocupante: nesse tipo de sistema, todos os aspectos do trabalho são monitorados e controlados por IA. Ela rastreia as atividades, comportamentos, resultados e a produção dos trabalhadores e gestores. Define metas e objetivos, atribui tarefas e papéis, avalia seu desempenho e os recompensa de acordo.

Porém, ao contrário do algoritmo frio e impessoal da Uber, os LLMs também podem ajudar os trabalhadores a melhorar suas habilidades e produtividade de maneiras que muitos humanos considerariam calorosas e persuasivas. A capacidade da IA de agir como um conselheiro amigável poderia diminuir a incômoda sensação causada pelo controle algorítmico.

Ainda assim, seria o algoritmo no comando. E se tem algo que a história nos ensina é que esse é um caminho provável para várias empresas, que veem a tecnologia como meio de exercer mais controle sobre os trabalhadores.

Outras possibilidades, mais utópicas, também existem. Não precisamos submeter um grande número de humanos ao controle tecnológico. Em vez disso, os LLMs podem nos ajudar a florescer. Há indícios presentes nos primeiros estudos de IA sobre outro caminho a seguir. Os trabalhadores, embora preocupados com a IA, tendem a gostar de usá-la quando esta ajuda a eliminar as partes mais tediosas e irritantes de seu trabalho, deixando-os com as tarefas mais interessantes.

Da mesma forma, as organizações centradas em IA podem se tornar mais significativas para funcionários engajados, apoiando a retenção de talento.

Só que nada disso é garantido. Gestores e líderes devem decidir se e como reorganizar o trabalho em torno da IA de forma que ela ajude, e não prejudique os trabalhadores humanos.

TRÊS PRINCÍPIOS PARA REORGANIZAR O TRABALHO EM TORNA DA IA

Como a IA pode tornar o trabalho melhor, em vez de pior? É hora de a liderança assumir papel ativo na resposta a essa pergunta.

Não existem parâmetros que determinem o que é certo ou errado ou as melhores formas de usá-la. Cada organização precisa descobrir por si mesma.

No entanto, você pode começar a adotar estes três princípios de liderança para orientar seu pensamento:

1 Identifique e traga para junto de si os usuários de IA na organização – Como já foi dito, muita gente está usando IA, mas escondendo isso de seus gestores. Só que a melhor maneira de a organização avançar nos seus experimentos com IA é com a contribuição desses trabalhadores, o que deve exigir uma grande mudança na forma como as empresas operam.

Os líderes devem reconhecer que esses funcionários – ou seja, as atuais habilidades de IA da empresa – podem estar em qualquer lugar da estrutura, com históricos e registros de desempenho variados. É recomendável envolver o maior número possível deles na construção dos planos de IA. Para isso, deverão prover-lhes de treinamento amplo e também de ferramentas para criar meios de compartilhar as lições aprendidas, por exemplo, bibliotecas de prompts do ChatGPT.

Outro desafio é minimizar o receio dos funcionários de revelar aos gestores o uso que já fazem de ferramentas de IA no dia a dia. Além de garantir que isso não coloca o emprego deles em risco, podem destacar a oportunidade de dedicar o tempo economizado com as soluções de IA em outros projetos mais interessantes ou, até mesmo, para melhorar o equilíbrio entre vida profissional e pessoal.

Porém, mais que permitir e incentivar o uso da IA, é preciso também oferecer recompensas relevantes àqueles que encontram oportunidades para melhorar os processos de trabalho. Considere oferecer prêmios em dinheiro, promoções, salas com janelas grandes, a possibilidade de trabalhar permanentemente de casa, entre outros.

Com os potenciais e possíveis ganhos de produtividade que o uso dos LLMs permite, as recompensas são um pequeno preço a se pagar por inovações verdadeiramente revolucionárias. Grandes incentivos também mostram que a organização leva a sério essa questão.

2 Deixe que as equipes desenvolvam seus próprios métodos – Em geral, as formas tradicionais como as organizações lidam com novas tecnologias não se aplicam bem à IA. São abordagens centralizadas e lentas. Os departamentos de TI enfrentam dificuldades para desenvolver modelos de IA internos que concorram com os principais LLMs.

Além disso, consultores e integradores de sistemas não possuem conhecimento especializado sobre como implementar a IA de maneira eficaz em uma empresa específica, nem sobre as melhores práticas para uso geral da IA. Grupos de inovação e conselhos de estratégia podem estabelecer políticas, mas não conseguem determinar como aplicá-la no dia a dia da organização – apenas as equipes de trabalho podem fazer isso.

E, considerando que as IAs se comportam mais como pessoas do que como software (mesmo que sejam software), muitas vezes é melhor gerenciá-las como membros adicionais da equipe. Esta, por sua vez, deve descobrir suas próprias maneiras de usar o recurso por meio de experimentos éticos e, em seguida, compartilhar esses métodos com outras equipes e com a liderança.

Para que isso aconteça, a cultura organizacional e a política de incentivos precisam estar alinhadas. As diretrizes têm que ser muito mais claras – inclusive por questões de governança e segurança – para que os funcionários se sintam livres para experimentar.

3 Construa para um futuro não tão distante – Tudo o que disse até aqui já é possível hoje em dia usando o ChatGPT-4. Mas modelos mais avançados estão surgindo – e rapidamente. A mudança organizacional, no entanto, leva tempo. As organizações que adaptam seus processos à IA ou aquelas que agora começarão a fazê-lo devem considerar as futuras versões da IA, em vez de construir seu plano para a tecnologia atual.

Se os ganhos de eficiência que estamos observando nos experimentos iniciais com IA persistirem, as empresas que aguardarem para só então iniciar seus próprios experimentos ficarão para trás.

SÓ HÁ DUAS MANEIRAS DE REAGIR À MUDANÇA PROFUNDA E EXPONENCIAL que a IA e os LLMs que a alimentam devem provocar na estrutura de trabalho: cedo demais ou tarde demais.

As ferramentas de IA de hoje ainda são falhas e limitadas em diversos aspectos. Embora isso ainda restrinja o que a IA pode fazer, suas capacidades estão aumentando – e a passos largos. Pode parecer cedo considerar mudar sua organização para acomodar a IA, mas há uma forte possibilidade de que “muito cedo” vire “tarde demais”

Principais takeaways

A entrada da inteligência artificial generativa nas organizações pode ajudá-las a começar a se redesenhar para o futuro. Isso pode envolver redefinição de papéis e responsabilidades, treinamento das pessoas em novas habilidades e o investimento em uma cultura organizacional que incentive a experimentação.

A liderança tem um papel fundamental em fazer com que os modelos de linguagem sirvam como orientadores e não para controle ou manipulação.

Três passos cruciais para a adaptação. O primeiro deles diz respeito à necessária inclusão de todos os usuários de IA nessa reorganização. O segundo remete a liberar cada equipe para criar seus próprios métodos – lembrando-as de que a IA se comporta quase como mais um membro do time, muito mais que como um sofware. E o terceiro tem a ver com antever os próximos LLMs, em vez de só focar o que há hoje.

Leia também

Conhecimento é poder? Hoje, só com letramento em IA

O império da personalização – e o que vem depois

Inteligência artificial: para onde caminha a humanidade?

Tecnologia para além do hype

Os desafios da identidade descentralizada

Federação de dados: associe-se a outras empresas e obtenha o melhor de sua IA

Um guia prático para extrair valor dos LLMs

SLMs, nossa próxima fronteira