É hora de regulamentar a inteligência artificial no Brasil?

O País sempre teve um bom histórico de regulamentação de tecnologias emergentes. Até agora

- Lições de casa vindas do futuro

- Não desista de uma nova tecnologia

- Três lições sobre estratégia com o ChatGPT

- Quando empresas devem agir juntas

- O complexo equilíbrio entre tradição e inovação

- Navegando entre o risco e a disrupção

- Manter os modelos de previsão no rumo certo é preciso

- Paranoia e pragmatismo: a receita de sobrevivência das empresas de consultoria e direito

- Como descobrir, e aproveitar, a inovação que brota fora dos núcleos de P&D

- Metamodernidade. Três inteligências. Gestão de risco ideal. Regulação de IA.

- A metamodernidade chega às empresas. E daí?

- As três inteligências da era da IA

- Em busca do sistema de gestão de risco perfeito

- É hora de regulamentar a inteligência artificial no Brasil?

- Quando se quer inovação, segurança psicológica e honestidade intelectual devem caminhar juntas

- A computação quântica e os negócios

- No coração do agro, ela quer ser polo de economia verde

- O segredo da mudança cultural: histórias

- Web3 ainda é apenas uma “assombração digital”

- Inteligência artificial chega para dar superpoderes às pessoas

O Congresso está avançando na regulamentação da inteligência artificial, e os impactos disso para o desenvolvimento econômico e social são enormes. Já existe um projeto de lei aprovado na Câmara, e outro no Senado segue a todo vapor. Agora que o Parlamento Europeu aprovou o IA Act, o ritmo vai só acelerar. Por isso, é urgente compreender melhor as escolhas que o Congresso está fazendo sobre a tecnologia, principalmente se quisermos um Brasil inclusivo e competitivo no futuro.

Vale lembrar que o País tem bom histórico de regulamentar tecnologias emergentes. Foi um dos pioneiros a criar regras para o uso da internet. É precursor no uso de blockchain no governo e na criação de moedas digitais pelo Banco Central. O Brasil é um dos maiores países em fornecimento de dados abertos e APIs, sem falar nas indústrias de software que se beneficiam da cultura aberta que adotamos desde os anos 1990.

Em regulamentação de tecnologia, o País é um lugar admirado, referência internacional. Mas o caminho a ser tomado para a inteligência artificial merece nossa atenção. Os ventos são outros, até porque o Brasil não é um líder no assunto. Em empresas e aplicações da tecnologia, quem está na frente são aqueles que têm mercado interno de chips e processadores, o que faz das big techs estrangeiras líderes favoritas. Em regulamentação da tecnologia, não seremos pioneiros, pois a União Europeia já aprovou o IA Act, que passa por ajustes finais antes de ser implementado.

Por aqui, temos alguns casos de IA de sucesso, como no Judiciário e no setor financeiro, mas precisamos de mais. O Congresso está avançado. A Câmara aprovou sua proposta ainda em 2021. O Senado lançou uma comissão de juristas para abordar o tema e o presidente da casa já referendou o texto. Ainda há muito chão pela frente, mas se compararmos o que o Brasil produz de tecnologia com o que o Brasil regulará, há um descompasso.

Existem pontos de atenção importantes. Precisamos prevenir e incentivar o uso de IA no País, mas o foco está muito na prevenção e pouco no incentivo. Esse é o ponto central para pensar no Brasil do futuro. Queremos ser rabo de bagre ou barbatana de tubarão? Queremos evitar concentração de mercado ou fomentar um ecossistema saudável de aplicações?

O primeiro ponto de atenção é saber que o Senado escolheu a Europa como norte a ser copiado. Fizemos caminho semelhante quando regulamentamos a proteção de dados pessoais, inspirando a nossa Lei Geral de Proteção de Dados Pessoais (LGPD) a partir da lei europeia. A ideia não é ruim, porque cria simbioses. Mas há um ponto de alerta.

Nos anos da regulamentação de proteção de dados, a Europa nadava de braçada. Os Estados Unidos eram contra um regramento amplo, favorecendo um sistema setor a setor. A China ainda não era uma potência digital, e outros países chegaram tarde no debate. O resultado disso é conhecido como um exemplo do “Efeito Bruxelas”: o padrão adotado na Europa se tornou referência para outros países, inclusive o Brasil.

Em IA, os ventos são outros. Em 2023, a regulamentação da União Europeia enfrenta forte concorrência de Estados Unidos, Japão, China, Reino Unido e mais de uma dezena de países que se prepararam e implementaram suas estratégias de inteligência artificial. Podemos olhar para Europa e nos inspirar, mas há outros referenciais a serem considerados.

O que significa olhar para Europa ao regulamentar a IA? Antes de tudo, é promover um regramento rápido, incentivado pelo pânico moral. Esse pânico está nas capas de revistas e jornais e em artigos científicos, o que faz parte do jogo. Há riscos, mas há pouca fala sobre os benefícios, dando fôlego ao medo como urgência de legislar. A ideia aqui é prevenir para não remediar, caminhos que trilhamos com sucesso antes, como na regulamentação de bombas nucleares ou de clonagem genética. Prevenir é colocar barreiras antes dos problemas se tornarem endêmicos.

Na prática, o IA Act cria quatro grandes grupos de usos de tecnologias, dosados na forma de risco. Um é o das aplicações que são tão perigosas que já aparecem na lista de usos banidos. Ali nem moratória se aplica: é riscar do mapa e ponto final. O segundo tem as aplicações de alto risco. Esses usos podem existir, mas exigem elevada carga de cuidados. Os dois outros grupos englobam a maior parte das aplicações: um é o de atenção e o outro é o que contém as aplicações que, se possível, devem ser até incentivadas.

Adaptações

O debate legislativo no Senado se inspirou no caminho europeu de gradação de risco, mas apimentou o conceito. Criamos grupos de aplicações banidas e de alto risco, mas na redação escolhemos fazer diferente. A forma como o IA Act insere usos em cada grupo é taxativa: existem os grandes temas e exemplos limitados de usos regulados – já aqui a forma como escrevemos é ilustrativa: há temas e exemplos, mas usamos a expressão “”tais como”” para deixar a porta aberta para proatividade. Na Europa há uma lista de compras e ponto final. Aqui há uma lista de supermercado, mas a busca por coisas novas na prateleira é incentivada.

Outro exemplo da adaptação que fizemos: um dos remédios que a Europa encontrou para evitar a concentração de mercados futuros é incentivar os sandboxes. Esse é um mecanismo que favorece o nascimento de modelos de negócio, com ajuda do Estado. Em vez de punir, incentiva-se o aprendizado conjunto, em ambiente de trocas entre governo e mercado.

No IA Act, sandboxes aparecem como obrigações dos governos, e há previsão para que pequenas e médias empresas estejam envolvidas nesse processo. Já por aqui invertemos as palavras. O governo não tem obrigação de criar sandboxes, cabendo à sociedade civil fazê-lo (e ao governo, se quiser, autorizar ou não que se faça). Sobre incentivos a novos modelos de negócio de pequenas e médias empresas, a lei não diz nada.

Essas são escolhas que o Congresso está fazendo nesse momento, e que têm consequências sobre o futuro do País. Estamos olhando a Europa, e fazendo vista grossa para como outros países estão regulando. Estamos restringindo aplicações de IA com incentivo à interpretação expansiva (em vez de sermos taxativos ao restringir o que é conhecido). Estamos dando ao Estado a opção de ajudar ou não a inovação, em vez de obrigá-lo a favorecer a indústria nacional.

Os resultados dessas escolhas são muitos: entre o caminho de prevenir e inovar (somando os dois), estamos favorecendo a prevenção (deixando a inovação para depois). Entre o caminho de legislar ou executar, favorecemos a implementação da lei (deixando o debate legislativo futuro como opção).

A Europa sabe bem o que procura: quer a soberania digital, conceito definido em diversas estratégias, e refletida em mais de uma dezena de marcos regulatórios, muitos deles já repercutindo aqui, como o Digital Services Act (DSA) e o Digital Market Act (DMA). Já o Brasil pode estar arriscando a sua soberania digital, adotando um padrão “internacional” para uma indústria que aqui é ainda incipiente, seja por não fabricarmos chips, seja porque nunca implementamos estratégia de inteligência artificial ou porque não investimos o suficiente em pesquisa.

Os Estados Unidos, a China e o Japão não estão copiando a Europa. Esses países estão criando regras setoriais próprias, favorecendo o mercado interno ou se dedicando a temas específicos, como a IA generativa. Estamos olhando pouco para esses exemplos.

O que as escolhas do Congresso significam para o desenvolvimento econômico e social por aqui? A inteligência artificial é uma dessas tecnologias que têm potencial disruptivo. A sua arquitetura e o seu jeito de ser são tão particulares que leis, mercados e normas sociais passam a gravitar ao seu redor. Isso faz da regulamentação dessa tecnologia uma urgência, e por isso devemos prestar mais atenção às escolhas que vêm sendo tomadas. A boa notícia é que o momento de intervir é agora. O debate no Congresso está começando. O Senado vai tramitar o projeto por comissões para tratar do assunto, e na Câmara é certo que existem visões antagônicas que gerarão novas oportunidades de incidência. Precisamos de mais vozes e mais argumentos, e precisamos ter mais claras as escolhas que estamos fazendo, no micro e no macro.

O Brasil, há muito tempo, é um caso a ser seguido quando falamos de regulamentação e aplicações de tecnologias emergentes. Nossa identidade “”tropicália”” e o debate democrático aberto geraram bons resultados (basta comparar com outros países, para entender que o que fizemos por aqui importa).

Enquanto isso, após o voto no Parlamento Europeu, mais de 150 empresas da Europa publicaram uma carta pedindo cuidado com os caminhos sendo tomados no Velho Mundo. O medo delas é que a inovação e o desenvolvimento sejam prejudicados. Por aqui, precisamos fazer igual, e trazer mais vozes para o debate, principalmente do setor privado e da comunidade técnica. Essas são as vozes que permitem que a prevenção e a inovação sejam aliadas, e não caminhos excludentes.

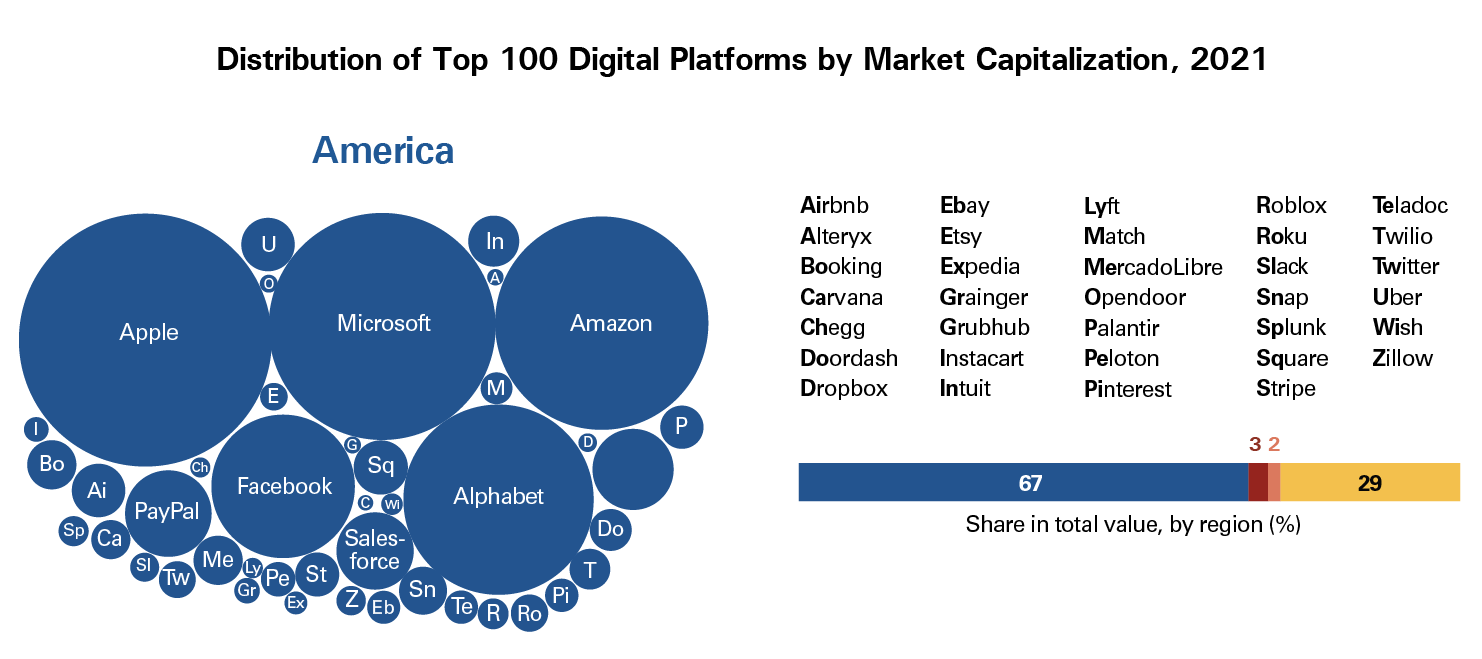

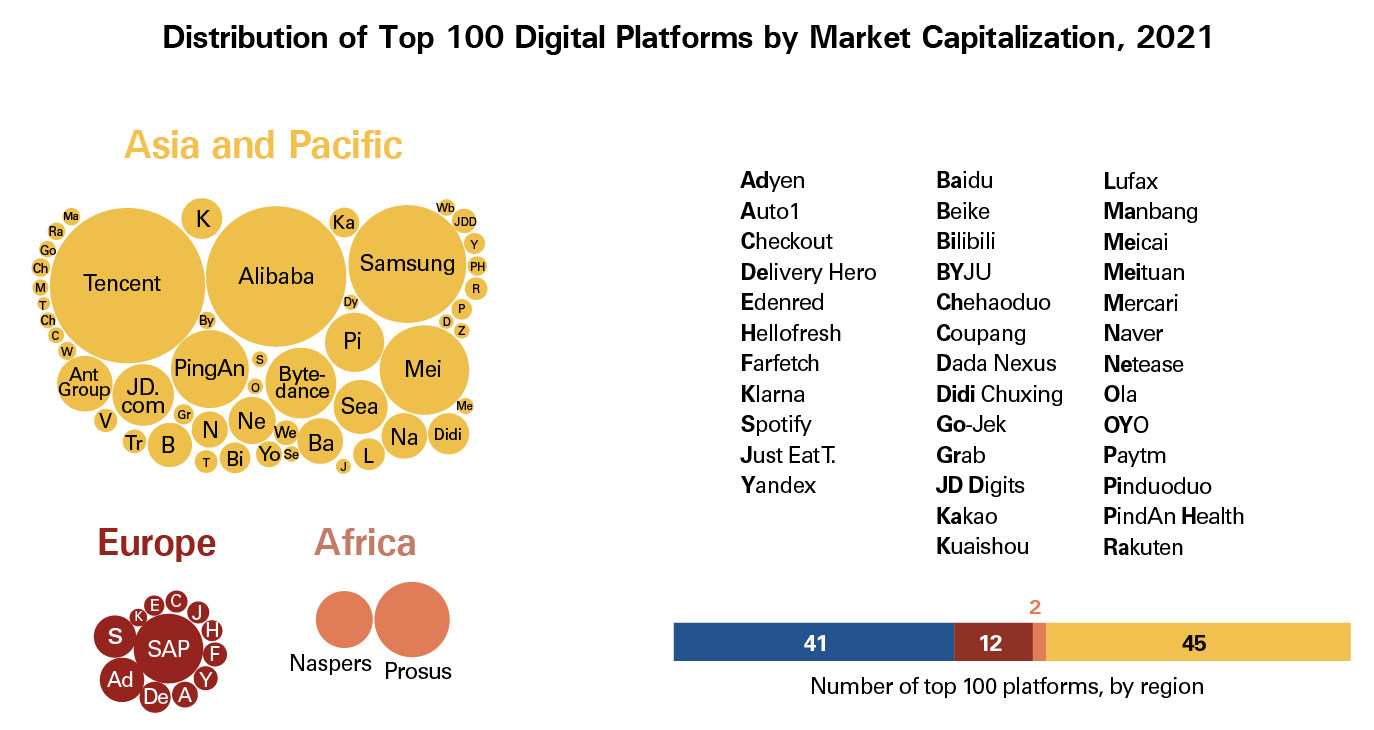

Fonte: Atlantic Council.

Fonte: Atlantic Council.

Fonte: Atlantic Council.

Leia também: A metamodernidade chega às empresas. E daí?

Artigo publicado na MIT Sloan Management Review Brasil nº 15.

Leia também

Conhecimento é poder? Hoje, só com letramento em IA

O império da personalização – e o que vem depois

Inteligência artificial: para onde caminha a humanidade?

Tecnologia para além do hype

Os desafios da identidade descentralizada

Federação de dados: associe-se a outras empresas e obtenha o melhor de sua IA

Um guia prático para extrair valor dos LLMs

SLMs, nossa próxima fronteira