IA human-centric – princípios e desafios

Os riscos de uma inteligência artificial cega aos ideais humanos são potencialmente maiores do que os benefícios. Mas tudo depende de como vamos segurar essa rosa

Contam que o velho oferecia rosas no parque. Sujeito de olhar castanho e fatiota alegre, de bengala em pulso. No que veio ter com ele aquele par de gêmeas, de 8 anos ou mais. O moço que habitava naquele corpo curvado pela idade sorriu ao oferecer duas rosas. Porém só uma delas aceitou, dizendo: “As rosas são tão lindas, vê?” O ancião, sem conter a surpresa, perguntou àquela que recusara a flor, qual a razão de tê-lo feito. A resposta veio curta: “Ela tem espinhos!”

Diante dos avanços da inteligência artificial (IA), algo semelhante acontece. Há o grupo dos otimistas que enxerga tudo cor-de-rosa, e há os que temem os espinhos. As duas perspectivas travam um duelo – ainda que desequilibrado, pendendo para os otimistas – para julgar se a IA trará um grande benefício ou uma assustadora ameaça para o futuro do bem-estar social.

FLOR E ESPINHO

Como a rosa oferecida às gêmeas, tendo a ver a IA na verdade como as duas coisas em uma só. Enquanto promete contribuir com aumento da eficiência e da conveniência para os indivíduos e para a sociedade, também possui potencial para promover disfunções profundas para o bom funcionamento social.

É entusiasmante, entretanto, observar a crescente manifestação em favor da reconciliação dos valores e princípios humanos no desenvolvimento e uso de inteligência artificial, como forma de garantir os benefícios e mitigar os riscos. Entre tantas iniciativas com esta orientação, vale destacar quatro delas:

– Manifeste des Digital Humanities, Paris, 2010.- Principles of a Human-centric AI Society, Council for Artificial Intelligence Technology Strategy, do Canadá, abril de 2016.- Artificial Intelligence Technology Strategy, Governo do Japão, março de 2017.- Vienna Manifesto on Digital Humanism, cientistas e pesquisadores de vários países, maio de 2019.

O que se observa em tais iniciativas é o resgate de ideais humanistas a partir da reflexão crítica sobre o avanço da IA.

Alguém eventualmente poderia perguntar: “Mas se o foco dessas manifestações é mitigar os riscos de uma IA cega aos ideais humanos, então os riscos não são maiores do que os benefícios?” A resposta, metaforicamente, é: depende de como você segura a rosa.

FILOSOFIA-BASE

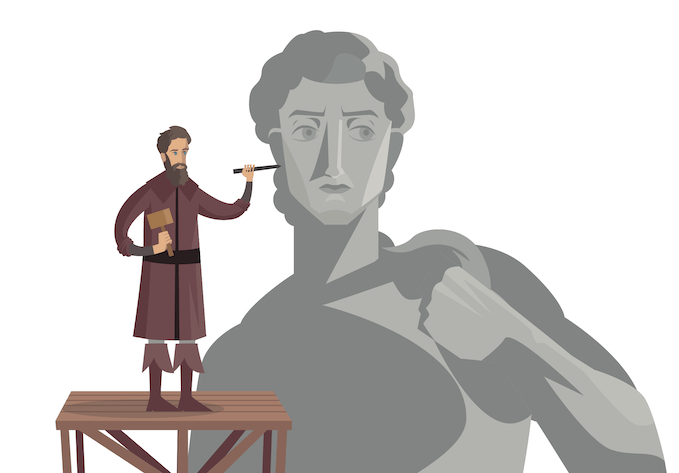

Não é a IA, por si só, que pode nos ferir. O que pode nos ferir é o modo com o qual a desenvolvemos e a aplicamos. Não é uma entidade que surge espontaneamente, de modo independente e com intenções próprias. Trata-se de um conjunto de algoritmos criado, mantido, aprimorado e usado por nós, humanos.

Tais inquietações são o tema central da human-centric AI, que quer definir princípios para a pesquisa e desenvolvimento desSa tecnologia. O núcleo desses princípios abriga considerações sociais inadiáveis.

A filosofia-base do tema engloba ao menos três valores de interesse geral:

– Dignidade – uma sociedade que não seja dependente da IA e que esteja segura de que essa tecnologia não será usada para controlar nossos comportamentos;- Diversidade e inclusão – uma sociedade que não encontre na IA vieses que desrespeitem ou ajuízem contra as diversas variações ou preferências humanas;- Sustentabilidade – o uso da IA para criar novos negócios e soluções, reduzir disparidades sociais, e possibilitar à sociedade meios para mitigar questões ambientais.

É com base nesses valores que são sugeridas orientações comprometidas com essa filosofia. Entre eles, destaco:

– Garantia dos direitos humanos fundamentais.- Esclarecimento educativo das peculiaridades da IA.- Privacidade de dados.- Gerenciamento da segurança cibernética.- Fair competition (competição justa).- Responsabilidade e transparência.- Inovação colaborativa.

Quando analiso as bases filosóficas que sustentam os princípios diretivos para a pesquisa e o desenvolvimento da IA, com este foco human-centric, não há como evitar a celebração. A lucidez destas considerações é espetacular.

GARANTIAS

Contudo, imediatamente, levanto uma questão: como poderemos garantir o cumprimento dessas diretrizes? De certo, a regulamentação é fundamental e conferirá sanções às corporações ou aos indivíduos que a desrespeite. Tudo bem. É um bom começo, porém estamos falando de AI. A coisa me parece bem mais complicada.

Vejam: inteligência artificial, no estágio em que a conhecemos, é um recurso que vai além da simples automação de funções repetitivas. As técnicas de machine learning (ML), capazes de treinar os modelos para que estes incrementem sua eficiência continuamente, já é suficiente para redobrar nossa atenção. O que impediria aquele colaborador daquela grande empresa de desenvolver um programa de AI, com técnicas de ML, que não observasse os princípios human-centric?

O ponto é que a governança de toda esSa disciplina não é apenas responsabilidade do Estado. É preciso que as corporações estejam imbuídas de gerir o uso da IA em suas iniciativas. Acrescente-se a isto a necessidade de compreender e adaptar a tecnologia às orientações dos manifestos em favor do humanismo digital.

QUESTÕES PARA AS CORPORAÇÕES

Proponho as seguintes questões:

– Como garantir que as inovações baseadas em IA abarquem os direitos humanos fundamentais? Como automatizar a análise do código para garantir tal objetivo?- De modo a certificar profissionais, gestores, conselheiros, membros do governo na compreensão das peculiaridades de IA, qual seria a métrica de sucesso? Teríamos algo como um certificado de proficiência, dizendo que somos aptos a executar nossas funções?- Como garantir que os dados, que serão coletados por sistemas de IA capazes de reconhecer pessoas e objetos do mundo, e ainda, capazes de interpretar comportamentos do mesmo modo que nós humanos fazemos, não sejam utilizados por outros sistemas de IA?- Como gerenciar o ecossistema cibernético de maneira integrada?- Qual a definição de fair competition em um mercado onde as decisões são feitas pela IA sem a intervenção humana?- O que é transparência para IA?

Enfim, trata-se de provocações para o qual não conheço respostas satisfatórias até o momento. Sei que vamos evoluir, porém desconheço o horizonte de tempo para isto.

NO JARDIM DE PEDRAS…

A rosa é linda. A rosa se destaca neste jardim de pedras. A rosa perfuma e mexe com a nossa imaginação. A criança se aproxima dela e, por descuido, enche a mão para toma-la pelo caule. Os espinhos machucam. E já é tarde demais. Ela já formou sua opinião sobre as rosas.”

Leia também

“Estamos usando IA demais?” – Uma conversa com Jeremy Kahn

Data fabric e IA generativa: a revolução na gestão de dados?

Privacidade e proteção de dados na era da inteligência artificial

Vício em telas, um problema cada vez maior no Brasil

Build the future: adaptabilidade e responsabilidade na era da IA

A oportunidade que temos com a transformação alavancada pela IA

As perguntas que você deveria fazer sobre IA para o planejamento de 2025

IA e dados na saúde: desafios e oportunidades